百度、2.4兆パラメータのオムニモーダル大規模モデル「ERNIE 5.0」を公開

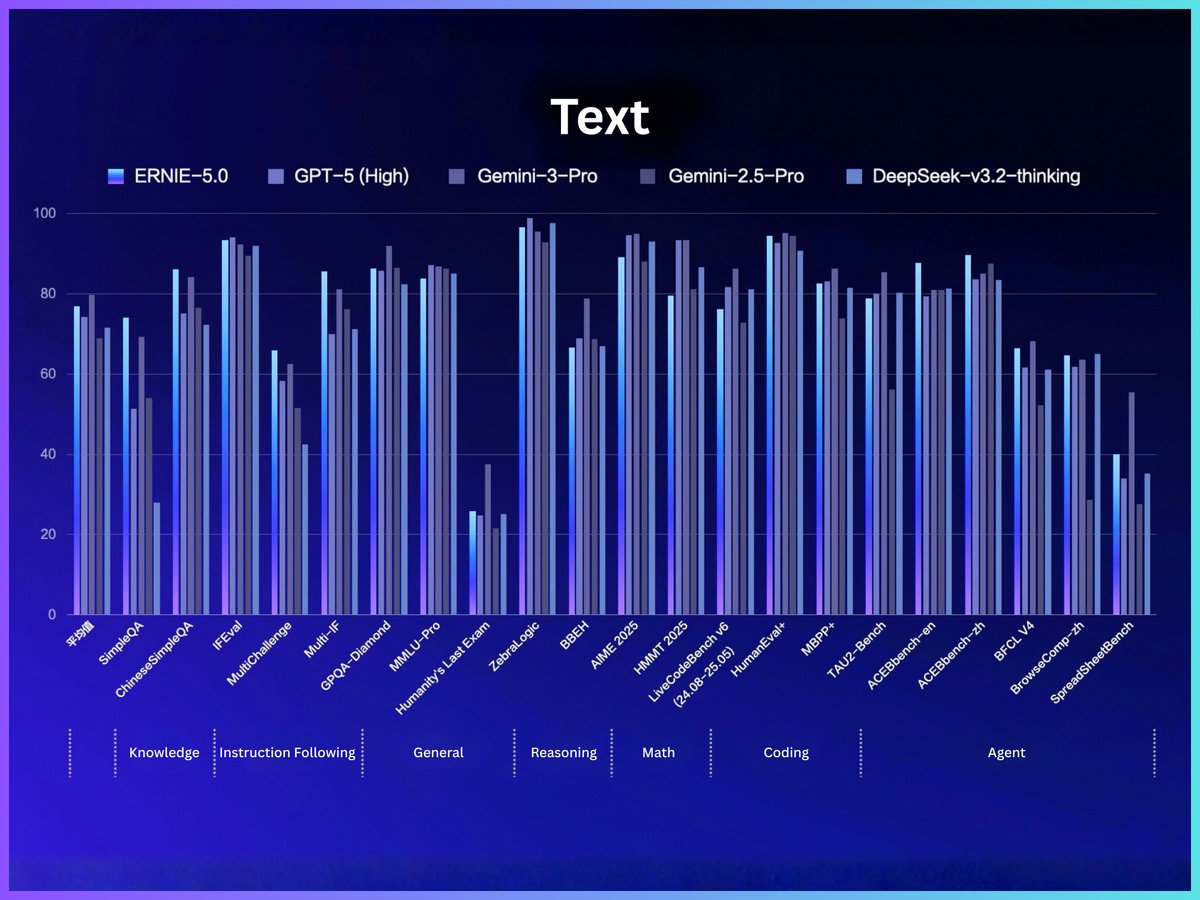

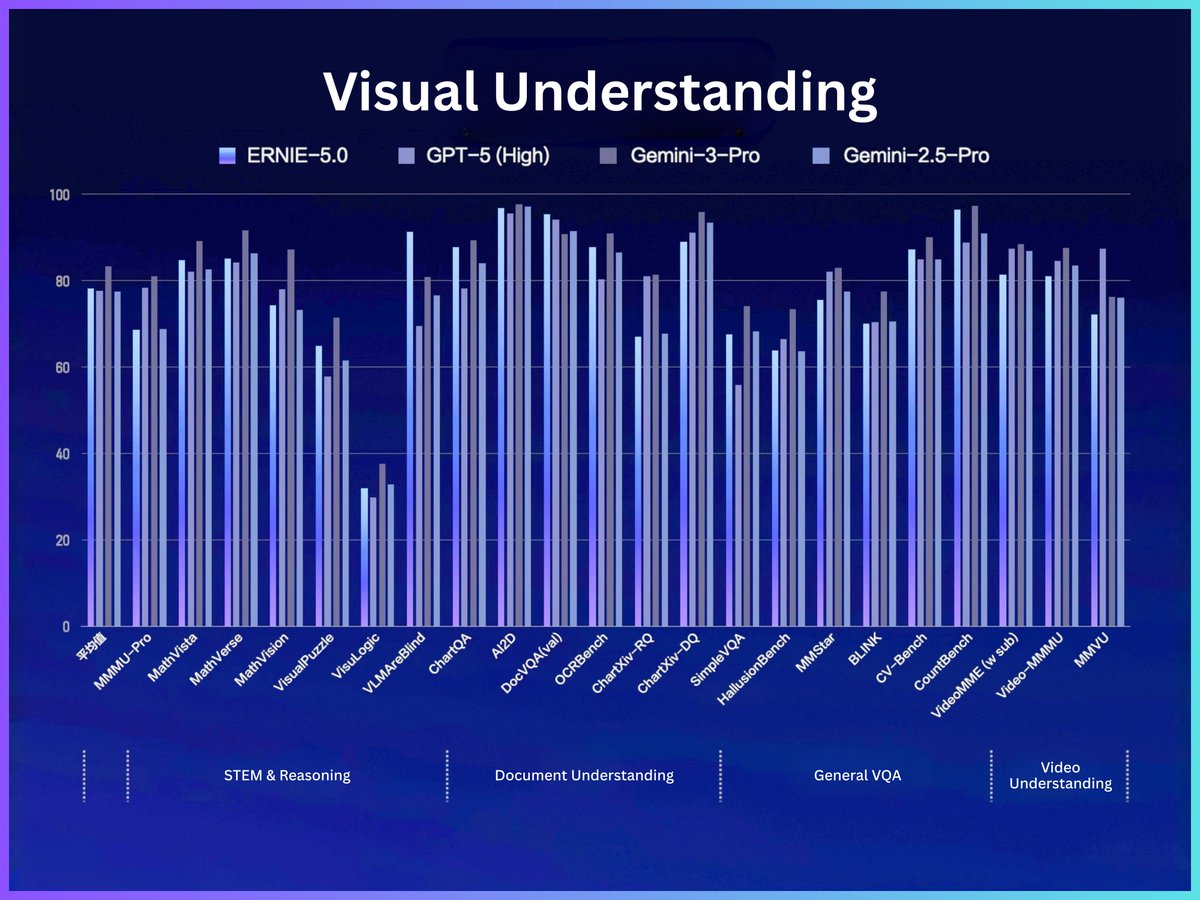

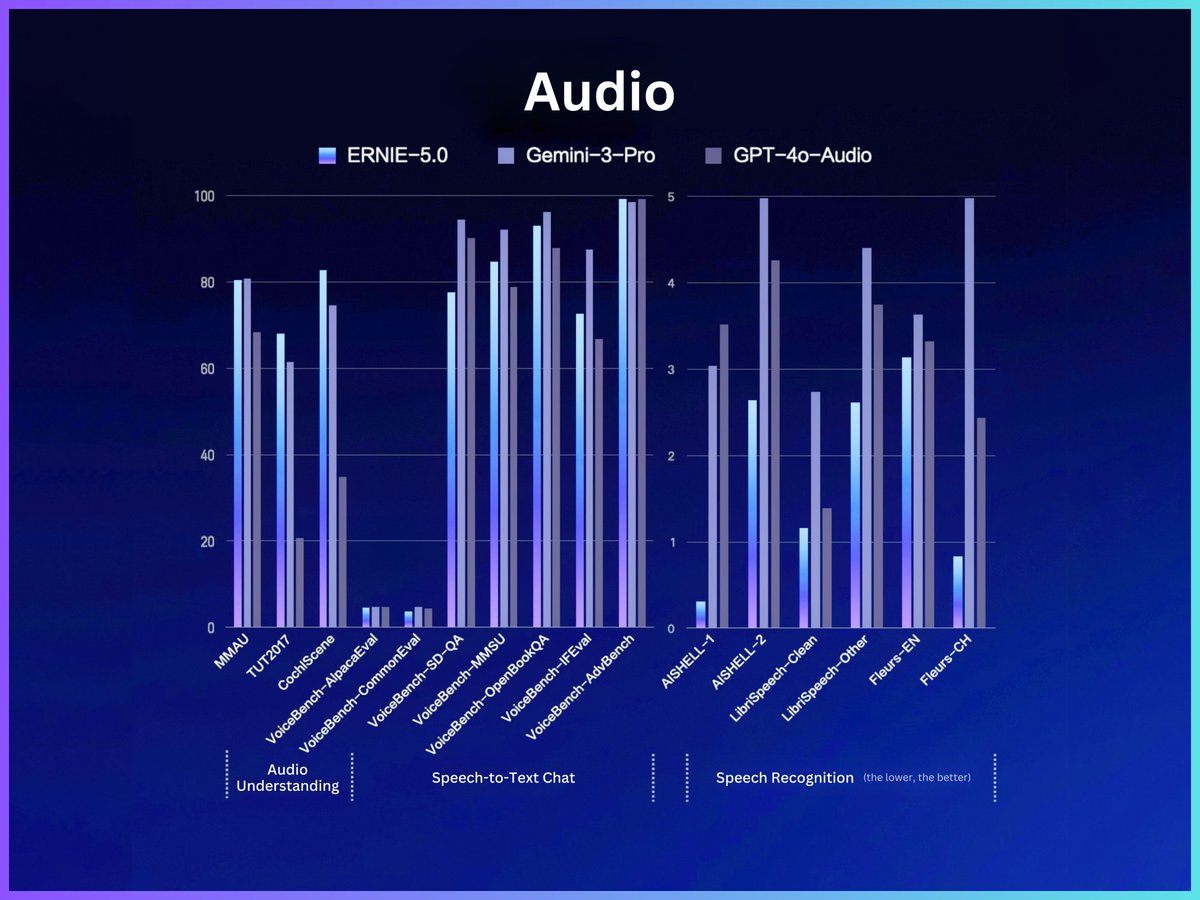

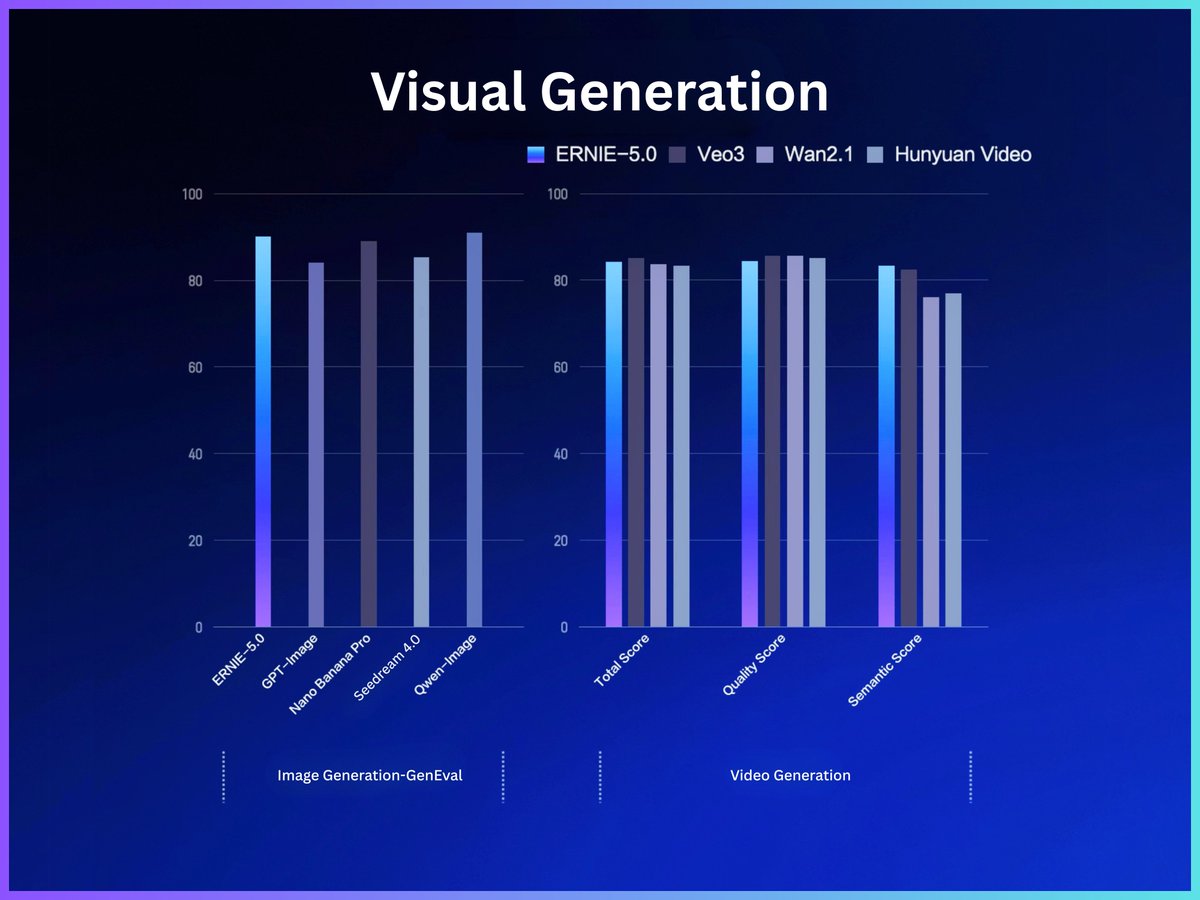

百度はネイティブオムニモーダル大規模モデル「ERNIE 5.0」を正式に公開した。2.4兆パラメータのMixture-of-Expertsアーキテクチャを採用し、統一的なマルチモーダル理解と生成を実現するとともに、推論時のアクティブパラメータを3%未満に抑えた効率性を備えている。

百度は最新のネイティブオムニモーダル大規模言語モデル「ERNIE 5.0」を公開した。このモデルはエンドツーエンドのアーキテクチャを基盤とし、2.4兆パラメータのMixture-of-Experts(MoE)構成を特徴とする。推論ごとに3%未満のパラメータのみを活性化することで、強力な推論・生成能力と効率的な性能を両立している。

「ERNIE 5.0」は百度のAI製品群における大きな進化を示しており、「ERNIE Bot」などのアプリケーションを支えるERNIEファミリーの最新版である。MoEアーキテクチャはパラメータのサブセットを選択的に活性化することでスケーラブルな知能を実現し、計算リソースを最適化しながら出力品質を維持する。このバランスにより、テキスト処理から画像・マルチモーダル相互作用まで幅広いタスクに対応可能だ。

同モデルは「ERNIE Bot」公式サイトでユーザーによる即時利用が可能となっている。企業顧客や開発者は百度AIクラウドの千帆モデルプラットフォーム経由で統合し、本番環境への展開を図れる。中国を代表する検索エンジン・AI企業である百度は、基盤モデルへの多大な投資を続け、世界的なAI競争に挑んでいる。

今回の公開は、多様なデータモダリティをリアルワールドアプリケーションで扱える効率的・高性能AIシステムへの百度の注力を強調している。

重要ポイント

- ERNIE 5.0 が正式に稼働開始である

- ネイティブ・オムニモーダル 大規模モデルである

- 統一マルチモーダル理解と生成のためのエンド・トゥ・エンド・アーキテクチャである

- 2.4兆パラメータの MoE アーキテクチャである

- 推論あたり3% 未満のアクティブ・パラメータである

- ERNIE Bot ウェブサイトで利用可能である

- Baidu AI Cloud の Qianfan Model Platform を通じて利用可能である

トピック

BaiduERNIEAI large language models

Original Post

Loading post...