MiniCPM-SALA:OpenBMBのハイブリッドモデルが長文脈を制す

OpenBMBは、MiniCPM-SALA(9B)をリリースしました。これは大規模訓練された初の疎線形注意ハイブリッドモデルで、フル注意モデルと同等の性能を保ちつつ推論コストを削減します。長文脈ベンチマークで平均38.97点のトップ成績を収め、3.5倍の高速化を実現しています。

OpenBMBは、業界初の大規模訓練された疎線形注意ハイブリッドアーキテクチャを採用した9Bパラメータモデル、MiniCPM-SALAを発表しました。この革新は、従来のTransformerモデルの二次方的計算複雑度やキー・バリューキャッシュのボトルネックという主要な制約を解消し、コアロジック能力を損なわずに優れた長文脈性能を実現します。

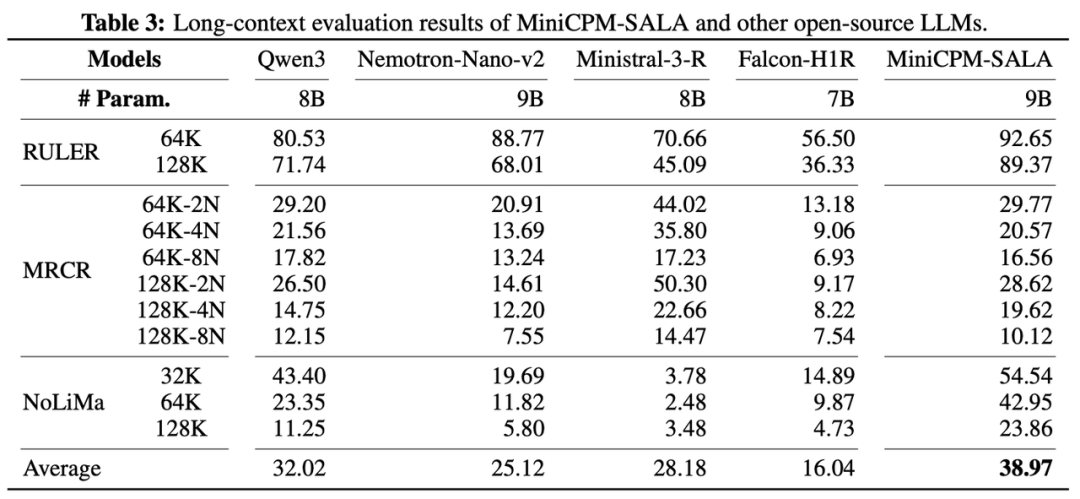

MiniCPM-SALAは、基本タスクでフル注意モデルと同等の性能を発揮しつつ、推論コストを大幅に低減します。長文脈理解評価では、Qwen3やNemotronなどの8B-9Bクラス競合を上回り、ベンチマーク平均スコア38.97を達成しました。

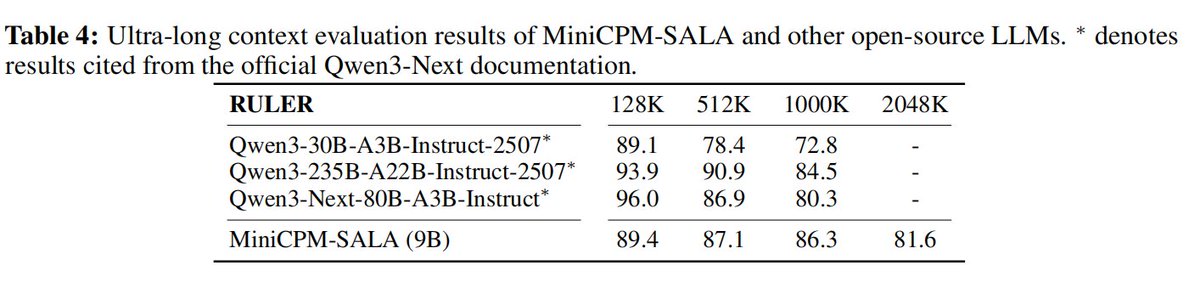

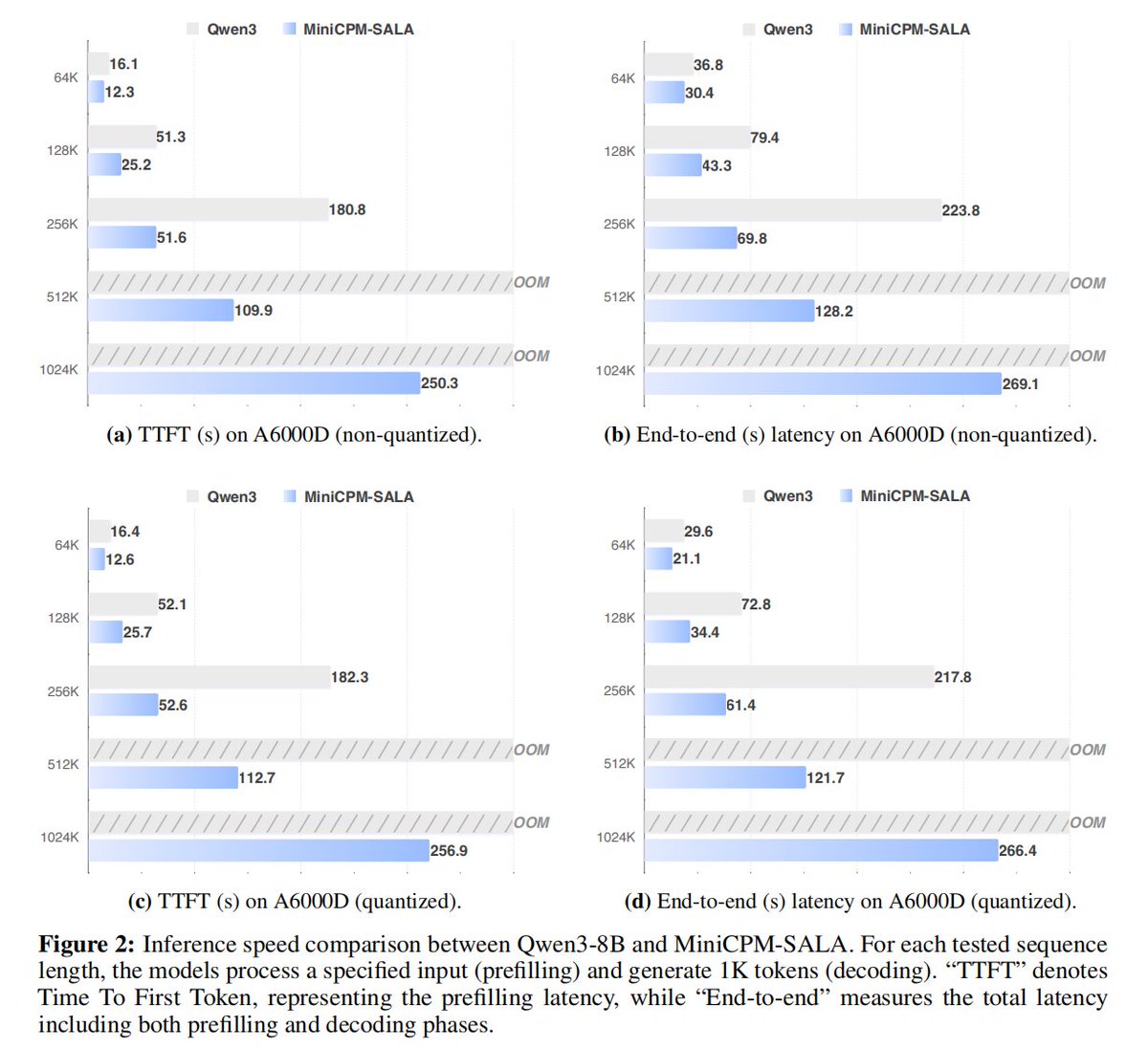

超長文脈スケーリングでも優位で、YaRNなどの追加手法なしに1000KトークンでRULERスコア86.3、2048Kトークンで81.6を記録しています。また、256Kシーケンス長でQwen3-8B比3.5倍のエンドツーエンド高速化を提供します。

標準モデルが128Kトークンを超えるとメモリ不足(OOM)エラーを起こすのに対し、MiniCPM-SALAはA6000Dや5090などのGPU上で100万トークンでの安定した低遅延推論を維持します。この能力は、数学・コーディングからエッジデバイス上での1M文脈処理まで多様な用途に及びます。

開発者はHugging FaceでMiniCPM-SALAにアクセスし、ハイブリッドアーキテクチャを試用してフィードバックを提供できます。

重要ポイント

- 9Bパラメータ

- 初の大規模疎線形注意ハイブリッドモデル

- 長文脈平均スコア:38.97(Qwen3、Nemotronを上回る)

- RULERスコア:1000Kで86.3、2048Kで81.6

- Qwen3-8B比3.5倍高速化(256K時)

- A6000D/5090 GPU上で1Mトークン安定推論