MiniMax、M2.5-HighSpeedを公開:100 TPSで3倍高速化

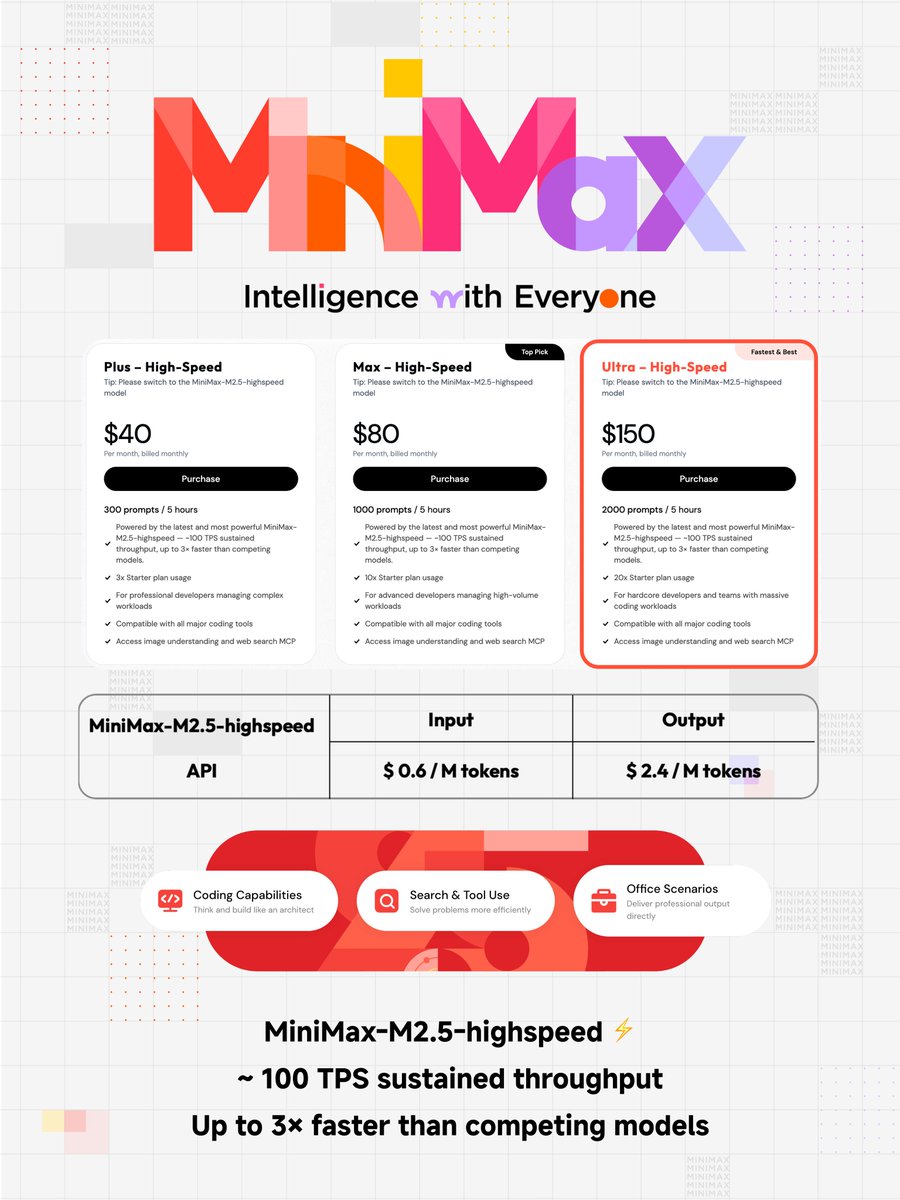

MiniMaxはM2.5-HighSpeedを正式に公開し、類似モデル比3倍の100トークン/秒(TPS)の高速推論を実現しました。次世代エージェントアプリケーション向けに設計され、API統合とコーディングワークフローをサポートします。

MiniMaxは、次世代エージェントアプリケーション向けに特化した高性能AIモデル「M2.5-HighSpeed」をリリースしました。この新モデルは、100トークン/秒(TPS)の推論速度を実現し、類似モデル比3倍の高速化を達成しています。

公開から48時間でユーザーから大きな支持を集めました。API経由のシームレスな統合とコーディングワークフローをサポートし、先進的なエージェントシステムを構築する開発者に柔軟性を提供します。

Plus、Max、Ultraのプランが用意されており、さまざまな利用ニーズに対応します。友人を招待すると即時10%割引が適用され、アクセシビリティを向上させています。

発表に際し、MiniMaxチームは旧正月のお祝いの言葉を述べ、马年のスピード、スケール、ブレークスルーを祈願しました。コミュニティとの交流を促進するため、モデルの体験談やフィードバックを募集し、上位コメントに対するプレゼントキャンペーンを実施しています。専用Coding Planのリンクも公開されています。

重要ポイント

- 100 TPSの推論速度

- 類似モデル比3倍高速

- API統合とCodingワークフローをサポート

- プラン:Plus、Max、Ultra

- 友だち招待で10%即時割引

- 次世代エージェントアプリケーション向け

- 公開から48時間

トピック

MiniMaxAI modelhigh-speed inferenceagent applicationsmachine learning

Original Post

Loading post...