Moonshot AI、MLLMの視覚中心的世界知識を評価するWorldVQAベンチマークを公開

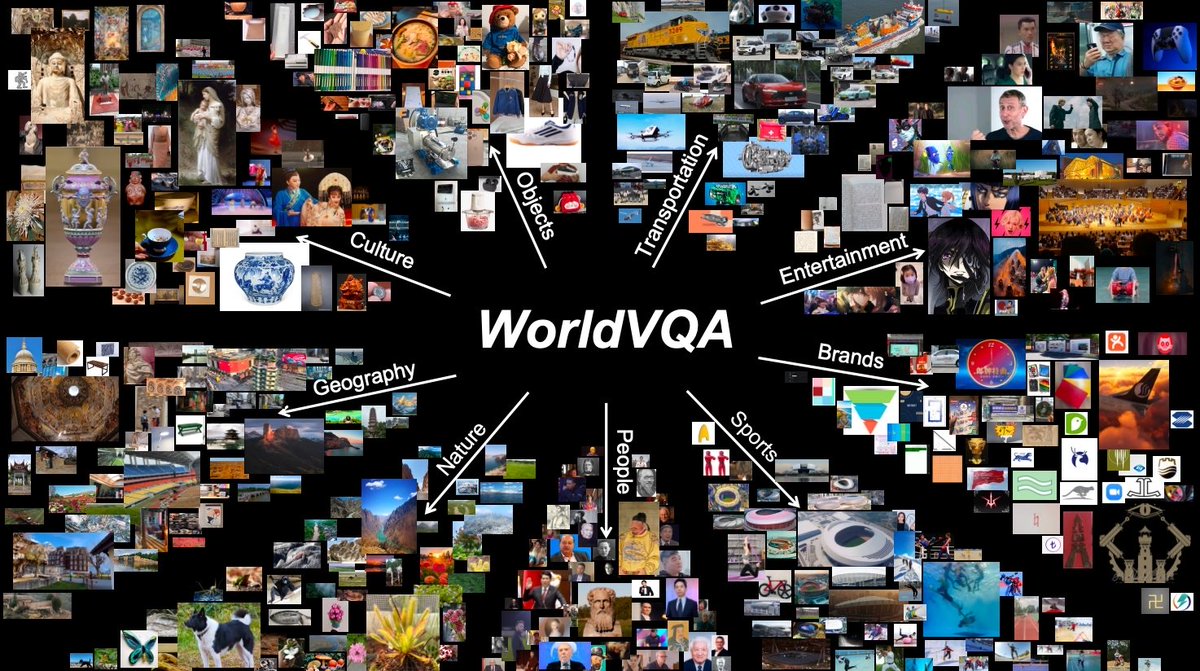

Moonshot AIは、推論から視覚知識検索を分離し、Multimodal Large Language Models(MLLM)の原子レベルの視覚中心的世界知識を測定する新しいベンチマークWorldVQAを導入しました。このベンチマークは、9カテゴリにわたる3,500のVQAペアを含み、言語的・文化的多様性に重点を置いています。

Kimi AIプラットフォームの開発元であるMoonshot AIは、Multimodal Large Language Models(MLLM)の原子レベルの視覚中心的世界知識を評価するための画期的なベンチマークWorldVQAを公開しました。

従来のMLLM評価手法は、視覚知識の検索と推論能力を頻繁に混同しており、モデルが実際に記憶している内容を特定することを困難にしています。WorldVQAはこの問題を解決するため、これらの要素を厳密に分離し、モデルの記憶された視覚知識にのみ焦点を当てています。

このベンチマークは、9つの多様なカテゴリに分散した3,500の慎重に選定された視覚質問応答(VQA)ペアで構成されています。言語的および文化的多様性に特に注意が払われ、データセットの堅牢性とグローバルな関連性を確保しています。

Moonshot AIの公式ブログで詳細情報とリソースが公開されており、研究者や開発者が利用可能です。WorldVQAは、MLLMの視覚的世界知識をより正確に診断し、より高性能で透明性の高いAIシステムの開発を支援します。

画像キャプション生成から視覚推論まで幅広いアプリケーションで注目を集めるMLLMにおいて、WorldVQAのようなベンチマークは評価の標準化と進歩を促進する重要な役割を果たします。Moonshot AIの取り組みは、厳格なAI研究と評価手法へのコミットメントを示しています。

重要ポイント

- WorldVQAはMLLMの原子レベルの視覚中心的世界知識を測定

- 視覚知識検索と推論を分離

- 9カテゴリにわたる3,500のVQAペア

- 言語的・文化的多様性に重点