MoonshotAI、Kimi K2.5の技術レポートを公開 ビジョン・エージェントでブレークスルー

MoonshotAIはKimi K2.5の技術レポートを公開した。このレポートでは、15兆トークンで事前学習したテキスト・ビジョンの共同訓練、4.5倍低いレイテンシの並列エージェントスウォーム、高効率ビデオエンコーディング、トークン節約型強化学習などの革新が示されている。これらの進展は、スケーラブルで実世界のエージェント知能の実現を目指している。

MoonshotAIは、Kimi.ai大規模言語モデルプラットフォームを運営する企業であり、Kimi K2.5の技術レポートを公開した。このレポートでは、マルチモーダルAI機能とエージェントシステムにおいて顕著な進展が概説されている。

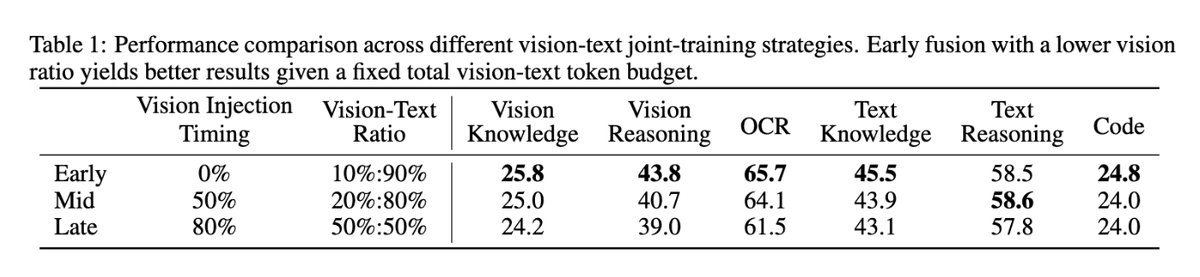

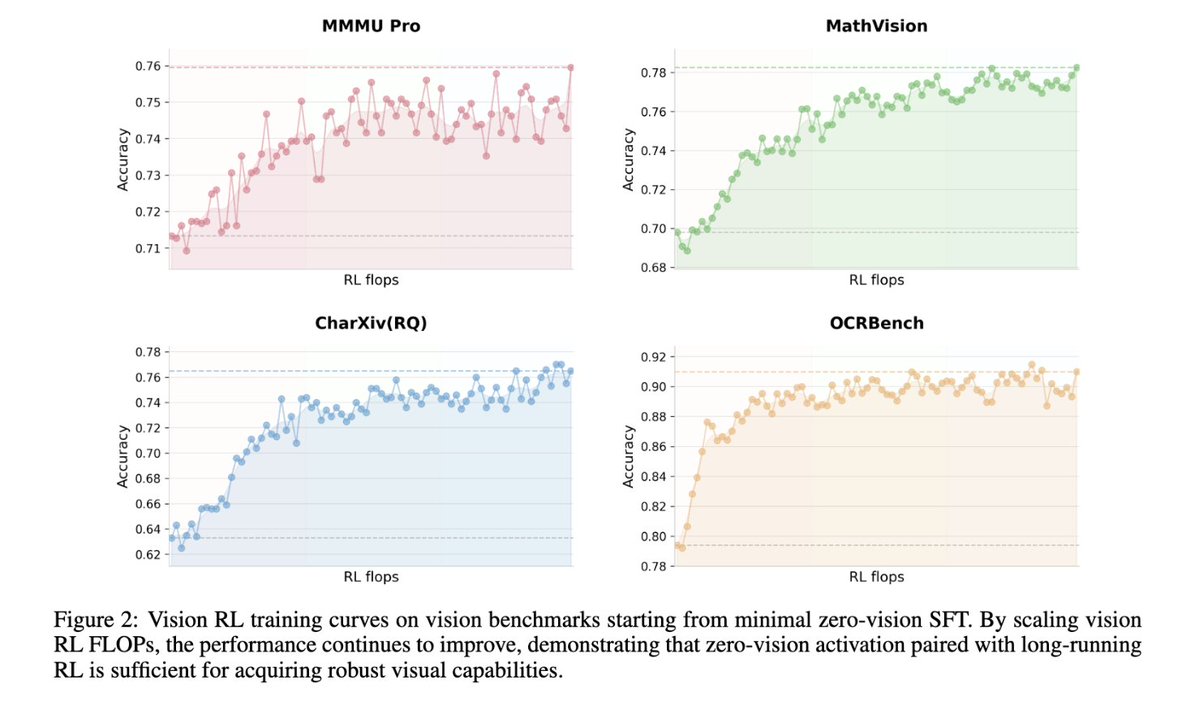

主なハイライトは、15兆のビジョン・テキストトークンで事前学習したモデルのテキスト・ビジョン共同訓練アプローチである。これに続き、追加のビジョン特化訓練データを使わずテキストのみのデータによるゼロ・ビジョン監督ファインチューニングにより、視覚推論能力が活性化される。

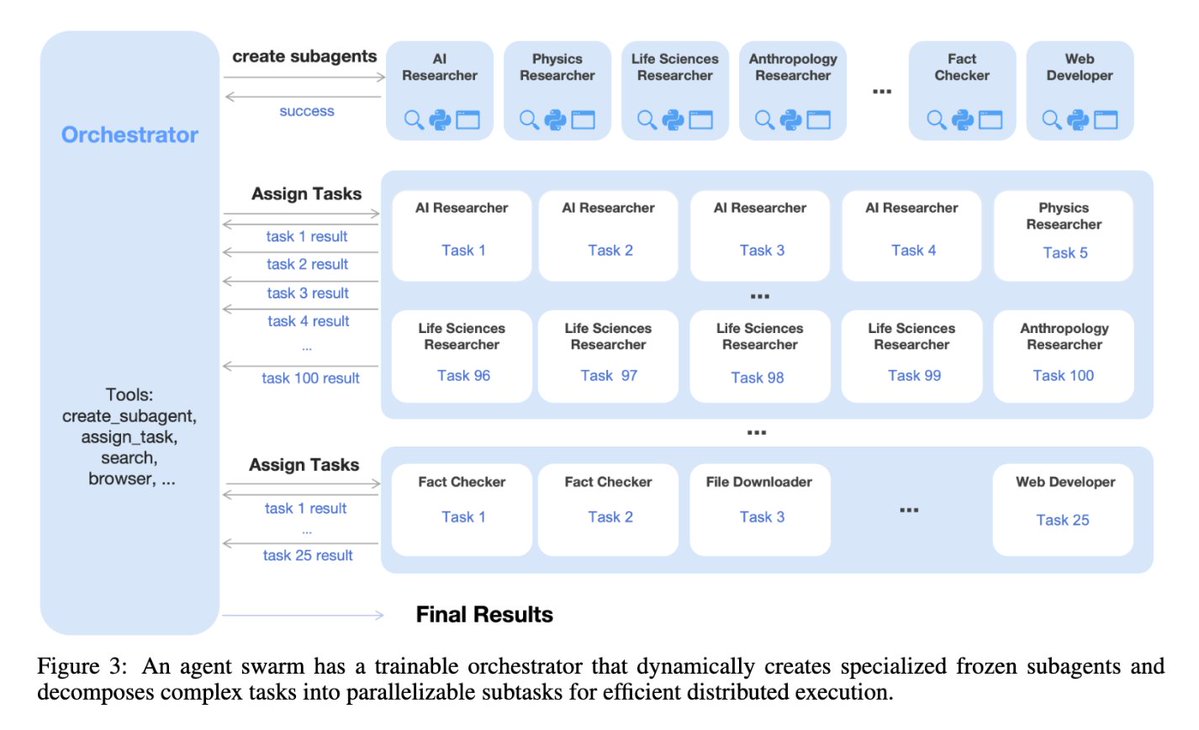

レポートでは、Agent SwarmとPARLを組み合わせたシステムが紹介されており、並列サブエージェントを動的にオーケストレーションする。これにより、最大4.5倍低いレイテンシが実現され、BrowseCompベンチマークで78.4%のパフォーマンスを達成し、複雑なタスクでの効率向上が示された。

もう一つの革新はMoonViT-3Dで、4倍の時間圧縮を特徴とする統一画像・ビデオエンコーダーである。これにより、同じコンテキスト長内で4倍長いビデオの処理が可能となり、動的視覚コンテンツの能力が向上する。

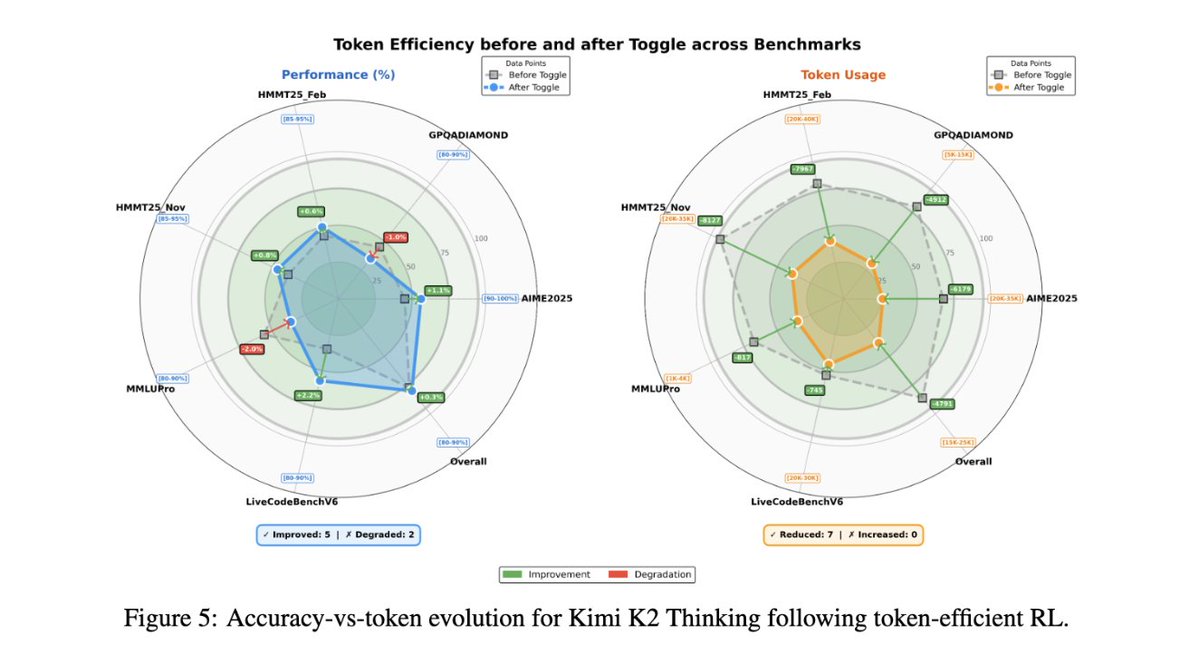

さらに、Toggleはトークン効率の高い強化学習を採用し、精度を維持しつつトークン使用量を25-30%削減する。これらの手法は一体となって、スケーラブルで実世界のエージェント知能に向けた推進力を生む。

技術レポート全文はGitHubで公開されており、研究者や開発者が手法と結果を詳細に探求できる。

重要ポイント

- 15兆のビジョン・テキストトークンで事前学習

- 視覚推論のためのゼロ・ビジョンSFT(テキストのみ)

- Agent Swarm + PARL:最大4.5倍低いレイテンシ

- BrowseCompで78.4%

- MoonViT-3D:4倍時間圧縮、4倍長いビデオ

- Toggle:25–30%少ないトークン、精度低下なし