Qwen、3.5 Mediumモデルシリーズを公開:より高い知能、より少ない計算資源

AlibabaのQwenチームは、Qwen3.5-Flash、35B-A3B、122B-A10B、27Bモデルを含むQwen 3.5 Mediumモデルシリーズをリリースしました。これらのモデルは計算資源を削減しつつ優れた性能を発揮し、35B-A3Bはより大規模な先行モデルを上回っています。

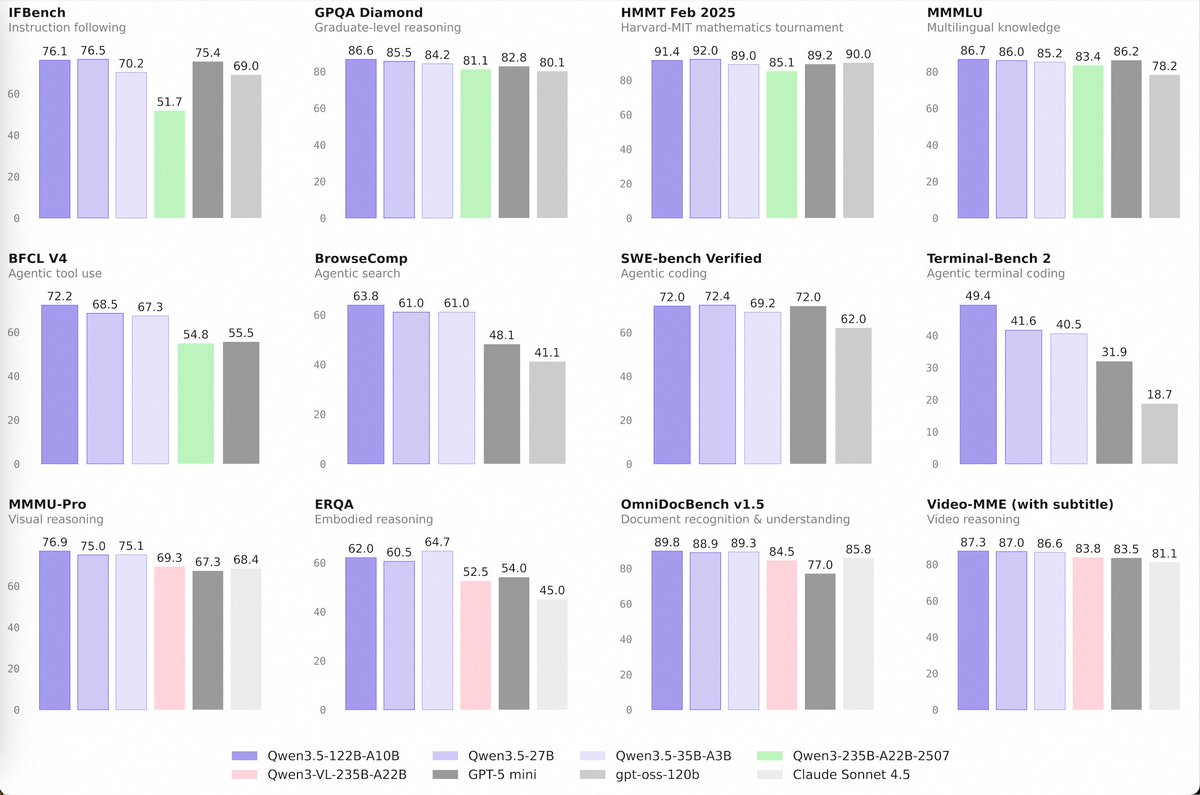

AlibabaのQwenチームは、Qwen3.5-Flash、Qwen3.5-35B-A3B、Qwen3.5-122B-A10B、Qwen3.5-27Bを特徴とするQwen 3.5 Mediumモデルシリーズを発表しました。このシリーズは、少ない計算資源でより高い知能を実現することを強調し、アーキテクチャ、データ品質、強化学習(RL)の進歩がパラメータ数の単純な拡大を超えることを示しています。

特にQwen3.5-35B-A3Bモデルは、より大規模なQwen3-235B-A22B-2507およびQwen3-VL-235B-A22Bのベンチマークを上回りました。これにより、最適化された設計が大量のパラメータなしで最先端レベルの能力を提供できることが証明されています。一方、Qwen3.5-122B-A10BおよびQwen3.5-27Bモデルは、中規模モデルと最先端フロンティアモデル間の性能格差を縮小しており、特に複雑なエージェントシナリオで顕著です。

Qwen3.5-Flashは、35B-A3Bモデルに準拠したホスト型プロダクションバージョンです。デフォルトで1Mのコンテキスト長と公式組み込みツールを備え、実世界の展開に適しています。

これらのモデルはHugging FaceやModelScopeなどのプラットフォームで公開されています。開発者はQwen3.5-Flash APIを利用でき、Qwen ChatでFlash、27B、35B-A3B、122B-A10Bの各バリエーションを直接試用可能です。

Alibabaの主力オープンソース大規模言語モデルシリーズであるQwenは、効率的なAI開発の限界を押し広げており、開発者に実験と成果共有を呼びかけています。

重要ポイント

- Qwen 3.5 Mediumモデルシリーズ:Qwen3.5-Flash、Qwen3.5-35B-A3B、Qwen3.5-122B-A10B、Qwen3.5-27B

- Qwen3.5-35B-A3BはQwen3-235B-A22B-2507およびQwen3-VL-235B-A22Bを上回る

- Qwen3.5-Flash:デフォルト1Mコンテキスト長、公式組み込みツール、35B-A3B準拠